1. Справжня автокорреляция не приводить до зміщення оцінок регресії, але оцінки перестають бути ефективними.

2. Автокорреляция (особливо позитивна) часто призводить до зменшення стандартних помилок коефіцієнтів, що тягне за собою збільшення t -Статистика.

3. Оцінка дисперсії залишків Se 2 є зміщеною оцінкою істинного значення σe 2. в багатьох випадках занижуючи його.

4. Враховуючи вище викладене, висновки з оцінки якості коефіцієнтів і моделі в цілому, можливо, будуть невірними. Це призводить до погіршення прогнозних якостей моделі.

16. Критерій діагностики автокорреляции Дарбина-Уотсона

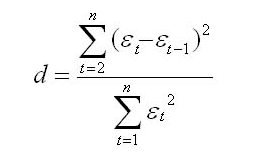

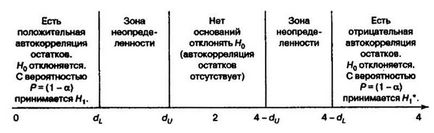

Найбільш відомим критерієм виявлення автокореляції першого порядку є критерій Дарбіна-Уотсона. Статистика DWДарбіна-Уотсона (або d-статистика) наводиться у всіх спеціальних прикладних комп'ютерних програмах як найважливіша характеристика якості регресійній моделі. Суть критерію полягає в тому, що на основі обчисленої статистики DWДарбіна-Уотсона робиться висновок про наявність автокореляції.

Розглянемо рівняння регресії виду:

де k - число незалежних змінних моделі регресії.

Для кожного моменту часу t = 1. n значення визначається за формулою:

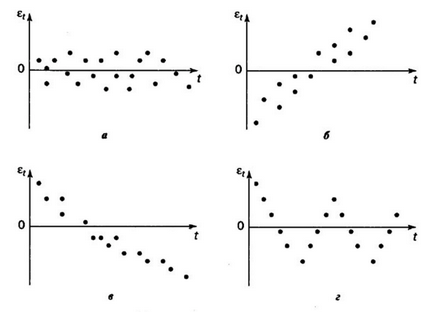

Вивчаючи послідовність залишків як часовий ряд в дисципліні «Економетрика», можна побудувати графік їх залежності від часу. Відповідно до передумовами методу найменших квадратів залишки повинні бути випадковими (а). Однак при моделюванні часових рядів іноді зустрічається ситуація, коли залишки містять тенденцію (б і в) або циклічні коливання (г). Це говорить про те, що кожне наступне значення залишків залежить від попередніх. В цьому випадку є автокорреляция залишків.

Методи визначення автокореляції залишків

Перший метод - це побудова графіка залежностей залишків від часу і візуальне визначення наявності автокореляції залишків.

Другий метод - розрахунок критерію Дарбіна-Уотсона.

Тобто критерій Дарбіна-Уотсонаопределяется як відношення суми квадратів різниць послідовних значень залишків до суми квадратів залишків. У завданнях з економетрики значення критерію Дарбіна-Уотсона вказується поряд з коефіцієнтом кореляції, значеннями критеріїв Фішера і Стьюдента.

17.Методи усунення автокореляції. Процедури оцінювання Кохрейна-Оркатта і Хільдрета-Лу

У зв'язку з тим, що наявність в моделі регресії автокорреляции між залишками моделі може привести до негативних результатів всього процесу оцінювання невідомих коефіцієнтів моделі, а саме до:

а) збільшення дисперсій оцінок параметрів моделі;

б) зміщення оцінок, отриманих за МНК;

в) зниження значущості оцінок параметрів,

автокорреляция залишків повинна бути усунена.

Основною причиною наявності випадкового члена в моделі є недосконалі знання про причини і взаємозв'язки, що визначають ту чи іншу значення залежної змінної. Тому властивості випадкових відхилень, в тому числі і автокорреляция, в першу чергу залежать від вибору формули залежності і складу пояснюють змінних.

Так як автокорреляция найчастіше викликається неправильної специфікації моделі, то необхідно, перш за все, скорегувати саму модель. Можливо, автокорреляция викликана відсутністю в моделі деякої важливої пояснює змінної. Слід спробувати визначити даний фактор і врахувати його в рівнянні регресії. Також можна спробувати змінити формулу залежності (наприклад, лінійну на гіперболічного і т. Д.).

Для простоти викладу AR (1) розглянемо модель парної лінійної регресії. Тоді спостереженнями t і (t - 1) відповідають формули: і.

Віднімемо від спостереження t співвідношення спостереження (t - 1), помножене на ρ:

Застосуємо перетворення моделі:

Тоді в нових змінних модель набуде вигляду: в якому шокова змінна вже не спотворена автокореляцією.

Дане перетворення (D) відноситься до класу декорреляции операторів [7]. Він призводить до втрати першого спостереження (якщо ми не володіємо попереднім йому наглядом). Число ступенів свободи зменшиться на одиницю, що при великих вибірках не так істотно, але при малих може призвести до втрати ефективності. Ця проблема зазвичай долається за допомогою поправки Прайса-Вінстена:

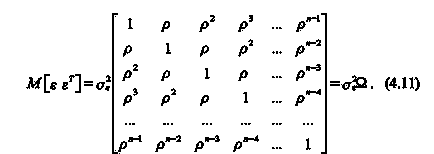

Можна показати, що в разі автокорреляции залишків ковариационная матриця вектора випадкових відхилень має вигляд:

В узагальненому МНК параметри рівняння регресії визначаються за формулою Ейткена:

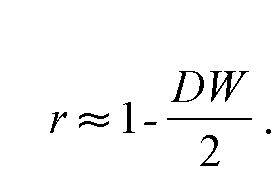

Однак на практиці значення коефіцієнта ρ зазвичай невідомо і його необхідно оцінювати. Існує кілька методів оцінювання ρ.

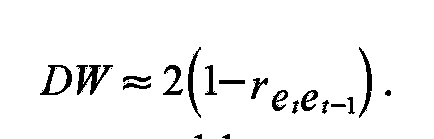

1. на основі статистики Дарбіна-Уотсона. Оскільки вона тісно пов'язана з коефіцієнтом кореляції між сусідніми відхиленнями через співвідношення

2.Метод Кохрейна-Оркатта. включає наступні етапи:

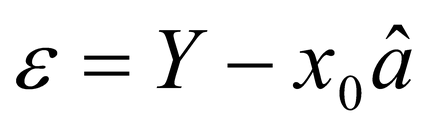

1. Застосовуючи МНК до вихідного рівняння регресії, отримують початкові оцінки параметрів a0 і a1; обчислюють залишки

2. В якості оцінки параметра ρ використовують його МНК-оцінку в регресії.

3. Застосовуючи Узагальнений МНК до перетвореному рівняння, отримують нові оцінки параметрів a0 і a1.

4. Будують новий вектор залишків

Чергування етапів здійснюється до тих пір, поки не буде досягнута необхідна точність, т. Е. Поки різниця між попередньою і наступною оцінками ρ не стане менше будь-якого наперед заданого числа.

Процедура КО реалізована в більшості ек комп'ютерних програмах.

3. Процедура Хільдрата-Лу також застосовувана в регресійних пакетах. Метод заснований на тих же принципах, але використовує інший алгоритм обчислень:

1. Перетворене рівняння оцінюють для кожного значення ρ з інтервалу (-1; 1) з заданим кроком всередині його.

2. Вибирають значення ρ, для якого сума квадратів залишків в перетвореному рівнянні мінімальна, а коефіцієнти регресії визначаються при оцінюванні перетвореного рівняння з використанням цього значення.

3. В околиці цього значення влаштовується дрібніша сітка і процес відбору найкращого значення ρ здійснюється до тих пір, поки не буде досягнута необхідна точність.