Боремося з крадіжкою контенту

Я теж вирішив подивитися, як йде справа з унікальністю моїх статей. Перевірив ті статті, які в минулому давали траф. а зараз чомусь запити втратили позиції. І о диво! (С) Така ж фігня ..

«Ось це прикол», - сказав я собі. Що найсумніше - сервіс від ЯВМ «Оригінальні тексти» не завжди «працює». Я все статті в нього додаю. Але, як написано в самому ЯВМ:

«Зверніть увагу, що ми не гарантуємо облік вашої заявки в роботі пошукових алгоритмів.»

Нещодавно я передумав :)

Вибрав самий нахабний сайт, який отримує хороший траф з моїх статей. Написав листа Платону і в підтримку хостингу, на якому той сайт хоститься.

Платоша, як і очікувалося, відповів:

Ну да ладно ... Вчити Яндекс мені чогось, все одно, що вчити збірну з футболу, як потрібно грати, дивлячись на їх гру по телевізору.

В хостинг направив такий лист:

Прохання не ігнорувати скаргу і вжити заходів.

Щиро Дякую.

-

З повагою, Олександр.

Через час прийшла відповідь:

В іншому випадку Вам потрібно буде звернеться в суд, і надати нам постанову суду про призупинення обслуговування даного клієнта.

Так само Ви можете у поза судовому порядку надати нам документи підтверджують, що це Ваша інтелектуальна власність.

Іншими словами, мене можуть послати в ліс збирати опеньки, так як ніяких документів у мене немає. нормально :)

Перевірка всіх сторінок сайту на унікальність

Якщо перевіряти кожну статтю руками, підуть роки. Тому я став шукати спосіб швидкої перевірки. Розглянув кілька сервісів і програм - всюди платити треба.

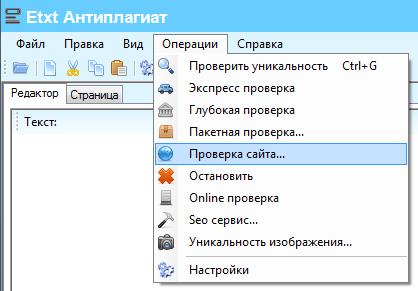

Але, хто шукає - той знайде :). Пакетно перевірити унікальність всіх статей на сайті допоможе безкоштовна програма Etxt Антиплагіат.

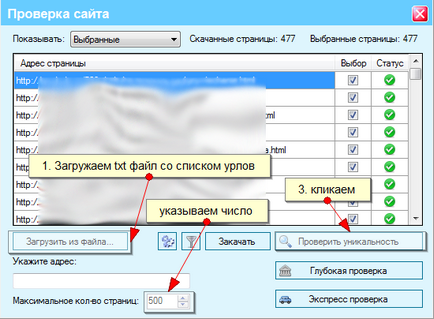

Розібратися в програмі просто - все російською мовою. Але чому то, вона у мене глючить. Наприклад, не бажає закачувати більше 40 сторінок з сайту (потім парсинг взагалі зупиняється). Але не біда, я знайшов, як цей глюк обійти. Розпишу тут, як я перевіряю:

2. Операції - Перевірка сайту.

Завантажив файлик, поставив максимальне число сторінок і ткнув «Перевірити унікальність».

Щоб не вводити кожен раз каптчі ПС руками, підключив antigate.com (дивіться в налаштуваннях програми).

Готово. Після закінчення тестів отримав звіт з% унікальності кожної статті та списком урлов на злодіїв.

Тепер виявляємо паразитів, пишемо їм листи (а краще їм і відразу в хостинг підтримку). Нехай або видаляють статтю або ставлять пряму індексованих посилання на статтю-джерело.

Все це напружує і забирає купу часу, але проблема спостерігається, і треба її вирішувати. Бездіючи, ми віддаємо свій трафік і підтримуємо злодіїв. А вони, дивлячись на свої успіхи, починають плодити все більше і більше говносайтов.

Зберігаємо унікальність статей на сайті

Про те, як захистити контент багато писати не буду. Написано вже багато матеріалу, але 100% захисту я так і не знаю.

Таким чином, ставлячи такий блокуючий скрипт ми погіршуємо зручність роботи користувача з інформацією. Сайт повинен бути для людей.

Що можна зробити:

1. Кожну статтю перед публікацією додати в ЯВМ «Оригінальні тексти». (Тепер можна додавати навіть сайти з тИЦ 0)

3. Можна поставити на сайт jQuery плагін для додавання посилань в буфер обміну (зробив на декількох сайтах - працює. Багато копіпастери залишили посилання.)

4. Відключити експорт статей в RSS якщо він не потрібен.

5. Вставляти посилання в статті на інші сторінки сайту. (Деякі грабери навіть не вирізають посилання).

7. Періодично стежити за унікальністю статей.

Хто ще чого знає?

Кнопки для залучення удачі:

Про наших рекомендаціях щодо розвитку сайту Ви можете прочитати на наступних сторінках:

Єдине поки не писав хостингу