Clearpath Robotics була заснована шість років тому трьома друзями по коледжу, яких об'єднала пристрасть робити всякі штуки. 80 фахівців компанії відчувають роботів для руху по пересіченій місцевості на кшталт Husky, чотириколісного робота, використовуваного міноборони США. Також вони роблять дронів і навіть побудували роботизовану човен Kingfisher. Однак одного вони точно ніколи не побудують: робота, який може вбивати.

Clearpath є першою і поки єдиною компанією з виробництва роботів, яка пообіцяла не створювати роботів-вбивць. Рішення було прийнято в минулому році співзасновником і CTO компанії Райаном Гаріпаем і за фактом навіть привернуло в компанію експертів, яким сподобалася унікальна етична позиція Clearpath. Етика компаній, що виробляють роботів, останнім часом виходить на передні позиції. Бачте, ми однією ногою в майбутньому, в якому будуть існувати роботи-вбивці. І ми поки абсолютно не готові до них.

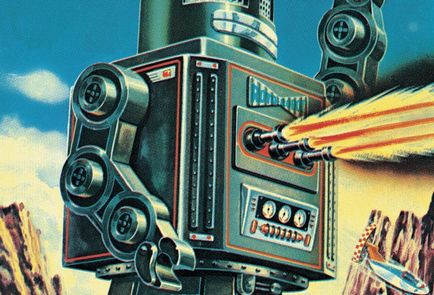

Звичайно, попереду ще довгий шлях. Корейська Dodam systems, наприклад, будує автономну роботизовану турель під назвою Super aEgis II. Вона використовує тепловізійні камери і лазерні далекоміри для виявлення і атаки цілей на відстані до 3 кілометрів. США, судячи за повідомленнями, теж експериментують з автономними ракетними системами.

За два кроки від «термінаторів»

Військові безпілотники на кшталт Predator в даний час управляються людьми, але Гаріпай каже, що дуже скоро вони стануть повністю автоматичними і автономними. І це турбує його. Дуже. «Смертоносні автономні системи зброї можуть зійти з конвеєра вже зараз. Але смертоносні збройові системи, які будуть робитися відповідно до етичних норм, - їх немає навіть у планах ».

Для Гарипов проблема полягає в міжнародних правах. На війні завжди бувають ситуації, в яких застосування сили здається необхідним, але воно також може наразити на небезпеку невинних перехожих. Як створити роботів-вбивць, які будуть приймати правильні рішення в будь-якій ситуації? Як нам визначити самостійно, яким має бути правильне рішення?

Подібні проблеми ми вже спостерігаємо на прикладі автономного транспорту. Припустимо, собака перебігає дорогу. Чи повинен робот-автомобіль згорнути, щоб не збити собаку, але піддати ризику своїх пасажирів? А якщо це не собака, а дитина? Або автобус? Тепер уявіть зону бойових дій.

«Ми не можемо домовитися про те, як написати посібник з експлуатації такого автомобіля, - каже Гаріпай. - А тепер ми ще й хочемо перейти до системи, яка повинна самостійно вирішувати, застосовувати їй смертоносну силу чи ні ».

Робіть круті штуки, а не зброя

Пітер Асара провів останні кілька років, лобіюючи заборона на роботів-вбивць в міжнародному співтоваристві, будучи засновником Міжнародного комітету з контролю роботизованих армій. Він вважає, що прийшов час для «чіткого міжнародного заборони на їх розвиток і використання». За його словами, це дозволить компаніям на зразок Clearpath продовжувати робити класні штуки, "не переживаючи, що їх продукти можуть бути використані для порушення прав людей і загроз мирним жителям».

Автономні ракети цікаві військовим, тому що вони вирішують тактичне завдання. Коли безпілотники з дистанційним управлінням, наприклад, працюють в бойових умовах, противник нерідко заглушає датчики або мережеве з'єднання, щоб людина-оператор не міг бачити, що відбувається, або керувати дроном.

Гаріпай каже, що замість розробки ракет або дронів, які можуть самостійно вирішувати, яку мету атакувати, військовим потрібно витрачати гроші на поліпшення датчиків і захисту від заглушення технологій.

«Чому б нам не взяти інвестиції, які люди хотіли б вкласти для побудови автономних роботів-вбивць, і не вкласти їх в підвищення ефективності існуючих технологій? - каже він. - Якщо ми поставимо завдання і подолаємо цей бар'єр, ми зможемо змусити цю технологію працювати на благо людей, не тільки військових ».

Останнім часом також почастішали розмови про небезпеку штучного інтелекту. Елон Маск турбується, що вийшов з-під контролю ІІ може знищити життя, якою ми її знаємо. Минулого місяця Маск пожертвував 10 мільйонів доларів на дослідження в області штучного інтелекту. Один з важливих питань про те, як ІІ вплине на наш світ. полягає в тому, як він зіллється з робототехнікою. Деякі начебто дослідника з Baidu Ендрю Нг турбуються, що майбутня революція ІІ відніме у людей роботи. Інші начебто Гарипов побоюються, що може відняти і життя.

Гаріпай сподівається, що його колеги, вчені і будівельники машин задумаються про те, що роблять. Тому і Clearpath Robotics прийняла сторону людей. «Хоча ми, як компанія, не можемо поставити на це 10 мільйонів доларів, але ми можемо поставити нашу репутацію».

Створення роботів-вбивць - дуже і дуже погана ідея Ілля Хель

Не було такого часу.

За часів античні перед початком бою могли влаштувати поєдинок найсильніших Войнов і якщо який переміг воєн був помітно сильніше переможеного то битва між арміями могла і не відбутися.

ЗИ: Коли люди билися мечами майстерність одного війна могло дати відчутну перевагу стороні на якій цей воєн бився. До речі, хороший мечник міг впорається з кількома десятками бандитів поодинці.

Створення будь-якої зброї - дуже погана ідея. Особливо зброї вражає більше однієї мети за раз. Чим автономний дрон пекучу у всіх без розбору гірше будь-якої сучасної системи реактивної артилерії, що зносять міста з мирними жителями? Так мабуть чимось і краще, від нього хоч стіни врятують. Моральні якості солдатів і людей їх направляють теж викликають побоювання за життя і здоров'я мирних жителів. Проблема в людях, а не в роботах. Люди і без них завжди знаходили і будуть знаходити, ніж вбивати, пригнічувати і грабувати інших людей. Тому що цінують життя людини в ламаний гріш. Але це якось не беруть до уваги, і виступають лише проти конкретних технологій.